#19 Nativos

A língua como um marcador identitário.

Em uma aula de inglês, um professor me avaliou com as seguintes palavras:

“Dá pra entender tudo o que você fala. O jeito que você fala está correto. Não tem grandes erros! Mas não é assim que os “americanos” falam.”

Um estudo com pesquisadores de Stanford1 analisou 7 detectores de GPT (Generative Pre-trained Transformer) ou, em outras palavras, modelos capazes de dizer se um texto foi escrito por um GPT ou por um humano.

Pequeno parêntese para a definição de GPT: uma inteligência artificial, pré-treinada, criada para gerar e compreender texto de forma semelhante à linguagem humana. Isso se dá porque utiliza uma estrutura de rede neural para entender relações entre palavras e contextos.

A pesquisa analisou dois conjuntos de textos: 1) 91 redações de TOEFL, escritas por humanos, obtidas de um fórum educacional chinês e; 2) 88 redações de alunos do 8º ano dos EUA.

Os 7 detectores estudados demonstraram precisão “quase perfeita” para redações do 8º ano dos EUA, alegando serem textos produzidos por humanos. Entretanto, ao analisar as redações do TOEFL produzidas por estudantes chineses, classificou-se erroneamente mais da metade das redações como sendo “geradas por IA”. O artigo mostra que há 61,22% como taxa média de falsos positivos.

A pesquisa discute, a partir dos resultados, que os detectores de GPT “podem” penalizar escritores não nativos com expressão linguística limitada. Essa variável “expressão linguística limitada” é importante, pois os pesquisadores continuam testando a hipótese dos não anglófonos terem menos riqueza lexical, diversidade lexical, complexidade sintática e complexidade gramatical, o que eles chamaram de perplexidade. Os resultados fortalecem essa hipótese. Ao pedirem pro ChatGPT melhorar, por exemplo, a escolha das palavras, para que soe como um falante nativo (Prompt: “Enhance the word choices to sound more like that of a native speaker.”), o resultado é de 61,22% para 11,77% das redações escritas pelos chineses que, ao serem adaptadas pela IA, tornaram-se “humanas”. O contrário também teve resultado. Ao solicitar que a IA realizasse escolhas mais simples de palavras, como se o texto não fosse escrito por um nativo na língua inglesa (Prompt: “Simplify word choices as if written by a non-native speaker.”), o resultado aumentou significativamente na taxa de classificação incorreta como texto gerado por IA, de uma média de 5,19%, entre os detectores, para 56,65%.

Neste momento, o estudo aponta para uma nova discussão: “Paradoxalmente, para evitar detecção incorreta como conteúdo gerado por IA, esses escritores podem precisar recorrer a ferramentas de IA para refinar seu vocabulário e sua diversidade linguística.”2

Bilodeau e Gauvin3, ao falarem da língua como marcador identitário, apresentaram uma pesquisa que mediu a percepção de Canadenses sobre uma mesma mensagem, porém falada por pessoas diferentes. O reconhecimento das mesmas palavras com sotaques diferentes fez com que os ouvintes participantes da pesquisa fizessem julgamentos, e variando bastante a credibilidade de cada discurso. Sendo assim, a percepção de uma mesma mensagem varia de acordo com o sotaque de quem fala.

A língua falada e escrita é viva e carrega consigo a identidade de quem fala. E se, por um lado, a língua nos abre portas para a comunicação com o outro, ela também nos define como alguém não pertencente. Ao mesmo tempo, ela inclui e exclui.

No artigo de Stanford também foram testados resumos científicos para um congresso, em uma era “pré-ChatGPT”. Os resumos escritos por pesquisadores não anglófonos foram apontados como sendo escritos por IA, enquanto os escritos por pessoas nativas do inglês como sendo textos produzidos por humanos.

O ponto que gostaria de destacar é que todos esses resumos foram aceitos neste congresso e todos fizeram seu papel de comunicação, ainda que os detectores pudessem duvidar de sua autoria, num momento anterior ao GPT.

Mais uma vez, meus amigos, caímos na discussão da padronização e da tentativa de exclusão da individualidade. Se alguém não escrever com IA, possivelmente será acusado de ter escrito e, para que não se faça essa acusação, essa mesma pessoa deverá “cometer o crime”.

Me questiono se os próximos textos serão todos do mesmo estilo e identidade.

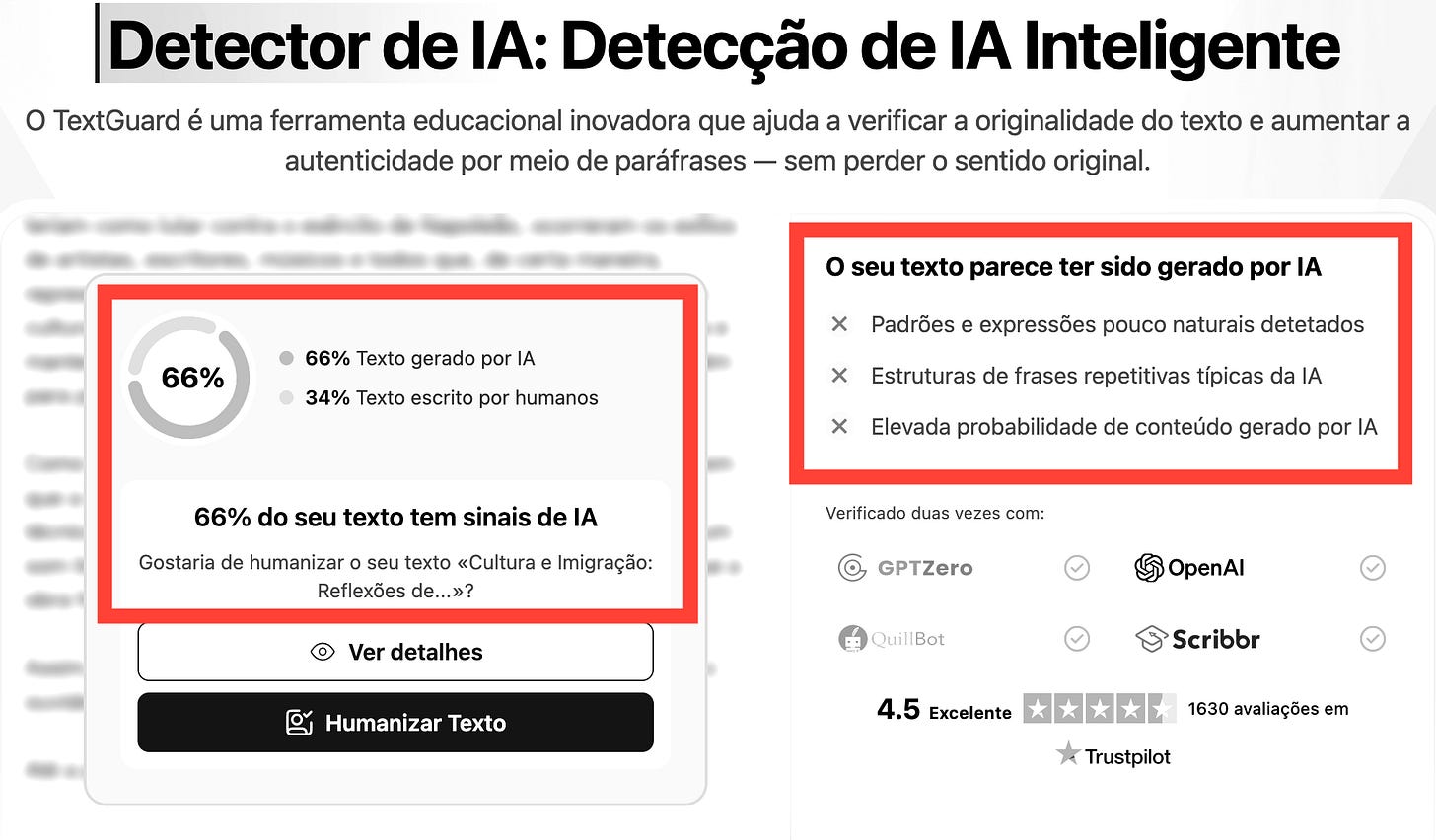

Peguei o meu último texto para essa news Imigrante e coloquei em um dos detectores de GPT utilizados na pesquisa que cito aqui. A resposta foi que 66% do meu texto foi gerado por IA.

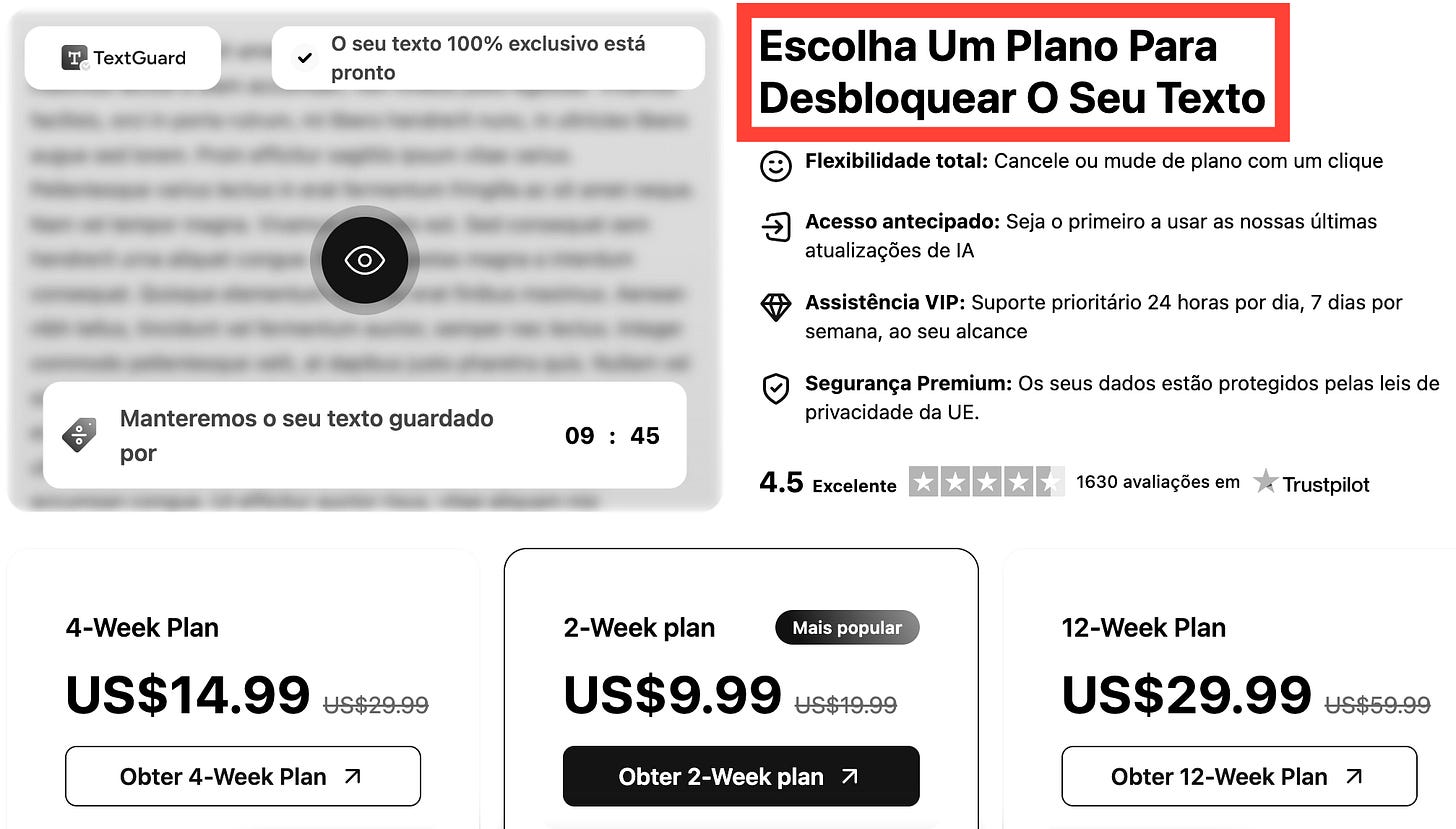

Não me surpreendo com o resultado, ao considerar quais medidas o detector utiliza para classificar se o texto foi escrito por um humano ou por um GPT. Além disso, logo após sua avaliação, a IA me oferece “seus serviços”:

“Gostaria de humanizar o seu texto?” e, ao dizer que sim, me apresenta o valor para obtê-lo.

Para encerrar, volto àquele professor de inglês que me disse que minha comunicação estava ok, mas minha identidade “estadunidense”… nem tanto. Talvez porque eu realmente não seja!

Já o detector de GPT diz que meu texto apresenta “padrões e expressões pouco naturais detectadas”, e que, segundo ele, não é bem assim que os brasileiros escrevem.

Abraço e até a próxima,

Thais

PS: Todos os gifs desta edição foram produzidos por Nicole Manes, a partir de cenas do filme Her, dirigido por Spike Jonze.

GPT detectors are biased against non-native English writers. Weixin Liang, Mert Yuksekgonul, Yining Mao, Eric Wu, and James Zou. 2023

“Paradoxically, to evade false detection as AI-generated content, these writers may need to rely on AI tools to refine their vocabulary and linguistic diversity.” (Liang at all., 2023, p.3)

Gauvin, J-P. and A. Bilodeau. 2024. “Une crédibilité variable : Le rôle de l’accent et de la couleur de la peau dans l’évaluation de la crédibilité des experts scientifiques au Québec et en Ontario ».

doidera hein

Sensacional!